Le mythe des 6 % : pourquoi la « mort du SaaS » est mathématiquement fausse

- 23 février 2026

- Temps de lecture : 3 minutes

Une diapositive circule actuellement dans les salles de conseil de la Silicon Valley et semble terrifier les investisseurs. Elle met en relation le coût marginal de génération du code avec la valeur d’entreprise des sociétés SaaS. Le raisonnement est simple et séduisant : l’IA fait tendre le coût de génération du code vers zéro ; par conséquent, la valeur de l’ensemble de l’industrie du logiciel devrait nécessairement s’effondrer.

La logique est convaincante. Elle est aussi mathématiquement et opérationnellement fausse. Le scénario pessimiste actuel concernant le SaaS repose sur une erreur fatale. Il suppose que les clients paient les éditeurs de logiciels uniquement pour la syntaxe. Ce n’est pas le cas. Ils paient pour un service qui garantit un résultat métier précis.

Lorsque l’on analyse le compte de résultat d’une entreprise SaaS moderne, il devient clair que l’IA ne remplacera pas le SaaS. Elle sépare simplement les gagnants — ceux qui ont conçu leurs plateformes pour l’intelligence — des perdants, qui se contentaient de vendre des formulaires connectés à des bases de données. Le SaaS n’est pas en train de mourir. Il devient le bouclier nécessaire entre le client et la complexité de l’ère de l’IA.

1. Le service est le véritable fossé concurrentiel.

Pour comprendre pourquoi le SaaS perdure, il faut décomposer l’acronyme.

« Software » (l’implémentation) : il s’agit des bits et des octets. L’interface utilisateur, les schémas de base de données et la logique applicative. Dans un monde dominé par l’IA, l’acte d’écrire du code devient une commodité.

« Service » (la valeur) : c’est ce que les entreprises achètent réellement. Le service inclut la disponibilité (99,99 % de disponibilité), la conformité en matière de sécurité (SOC2, HIPAA), la gouvernance des données et le support client.

Cependant, savoir quoi écrire reste rare. L’expertise métier, la logique complexe des processus et la compréhension de l’activité du client ne peuvent pas être automatisées. L’IA peut poser les briques, mais il faut toujours un architecte doté d’une connaissance approfondie du secteur pour dessiner les plans.

Même si l’IA écrit le code, qui se lève à 3h du matin lorsque le serveur tombe en panne ? Qui assume la responsabilité si les données sont compromises ? Qui définit la feuille de route lorsque la réglementation évolue ?

L’enveloppe de « service » autour du logiciel est ce qui protège le client du chaos du code brut. À mesure que le code devient moins cher, la confiance apportée par le service devient l’actif premium.

2. Les chiffres : pourquoi l’IA n’impacte que 6 % du compte de résultat.

Regardons les chiffres. Le discours sur la « mort du SaaS » suppose que l’écriture du code représente 90 % de la structure de coûts d’une entreprise. Ce n’est pas le cas.

Si les startups en phase initiale investissent effectivement beaucoup dans la construction du produit, l’état stable d’une entreprise SaaS rentable est une machine de distribution, pas un atelier de codage. Pour les entreprises SaaS matures et efficaces, le budget R&D représente souvent entre 10 % et 25 % du chiffre d’affaires total. La majorité des coûts concerne les ventes, le marketing, la réussite client, l’hébergement et les opérations.

En regardant plus en détail ce budget R&D :

- La part « codage » : les ingénieurs ne passent qu’environ 25 % de leur temps à écrire du code. Les 75 % restants sont consacrés à des tâches à forte valeur ajoutée : décisions d’architecture, modélisation métier et interprétation des besoins utilisateurs.

- Le calcul : 25 % (temps de codage) × 25 % (budget total R&D) ≈ 6 % d’impact.

L’IA rend la création de logiciels légèrement moins coûteuse, mais ne transforme pas fondamentalement le modèle de coûts. Elle libère simplement la R&D pour se concentrer sur la partie la plus difficile du logiciel : définir la solution.

Cependant, les acteurs établis ne peuvent pas se permettre de se reposer sur leurs acquis. Si les économies sont limitées, le risque lié à la vitesse d’innovation est existentiel. Un challenger ne vous battra pas parce qu’il est moins cher, mais parce qu’il peut innover beaucoup plus vite. L’objectif de l’IA n’est pas de réduire les budgets ; c’est de doubler la vitesse de livraison.

3. Le coût caché de l’inférence : pourquoi l’IA crée un plancher économique.

Voici ce que les partisans du « SaaS est mort » ne voient pas : même si les coûts de développement ponctuels peuvent diminuer, les coûts opérationnels récurrents vont structurellement augmenter. Les logiciels ne fonctionnent pas par magie ; ils fonctionnent sur du matériel.

- Ancien monde : le logiciel traditionnel est déterministe. Il fonctionne sur des CPU. Il est efficace, peu coûteux et prévisible.

- Monde de l’IA : les logiciels natifs de l’IA sont probabilistes. Ils nécessitent des GPU et d’importantes opérations d’inférence pour fonctionner.

Chaque fois qu’un utilisateur interagit avec un système « intelligent » en posant une question en langage naturel ou en demandant un résumé, cette requête consomme beaucoup plus d’électricité et de cycles matériels qu’une requête traditionnelle sur une base de données.

Nous échangeons une réduction de 6 % des coûts de développement contre une explosion des coûts opérationnels récurrents.

Le « service » devient la couche d’optimisation

Comme les coûts d’exécution vont augmenter, le rôle de l’éditeur SaaS devient encore plus critique. Il agit comme arbitre de l’efficacité. Il doit gérer une infrastructure hybride : maintenir des systèmes déterministes pour les 90 % des tâches qui doivent être rapides, peu coûteuses et parfaites (transactions, stockage), et n’injecter l’IA probabiliste que là où elle apporte un raisonnement à forte valeur.

Cette réalité hybride révèle la faille du récit de la disruption.

La peur dominante est qu’un développeur solitaire génère un clone de Salesforce, Workday ou ServiceNow en un week-end et le vende pour quelques centimes. Mais pour rivaliser dans cette nouvelle ère, ce clone ne peut pas être simplement un formulaire sur une base de données ; il doit être intelligent. Il doit utiliser l’IA en temps réel.

Même si un challenger génère le code gratuitement, il ne peut pas l’exécuter gratuitement. Il doit faire face à un coût élevé des ventes sous forme de factures d’inférence. Il ne peut pas casser fortement les prix du marché car il doit couvrir ses propres coûts CPU et GPU.

Cela crée un plancher économique solide. Le récit selon lequel l’IA entraînera une « course vers le bas » des prix est mathématiquement erroné. Il n’existe aucun scénario dans lequel le coût total de fourniture d’un système intelligent capable de raisonnement diminue. La base de coûts augmente et, par conséquent, la valeur du logiciel — et son prix — augmenteront probablement. Cependant, ce pouvoir de fixation des prix est réservé à ceux qui maîtrisent l’architecture hybride nécessaire pour maintenir les coûts sous contrôle.

4. La colonne vertébrale déterministe : plan d’architecture d’un système natif de l’IA.

Si le modèle économique est viable, la question devient : comment construire pour cet avenir ? Beaucoup imaginent qu’un système natif de l’IA est un système où un LLM comme ChatGPT ou Claude génère du code à la volée et pilote toutes les actions. Le récit suggère qu’à l’avenir, chaque action sera déterminée par un LLM.

Aussi séduisante que soit cette vision, elle ne résiste pas à la réalité des environnements critiques.

Dans des secteurs comme la logistique ou la banque, « probablement correct » équivaut pratiquement à « incorrect ». Les entreprises ne peuvent pas se permettre un système de production où un LLM génère un code différent d’un jour à l’autre.

La véritable valeur pour l’entreprise réside dans la fiabilité, pas seulement dans la créativité. Un véritable système « AI-native » n’est pas un système écrit par l’IA, mais un système conçu pour être orchestré de manière sûre par l’IA.

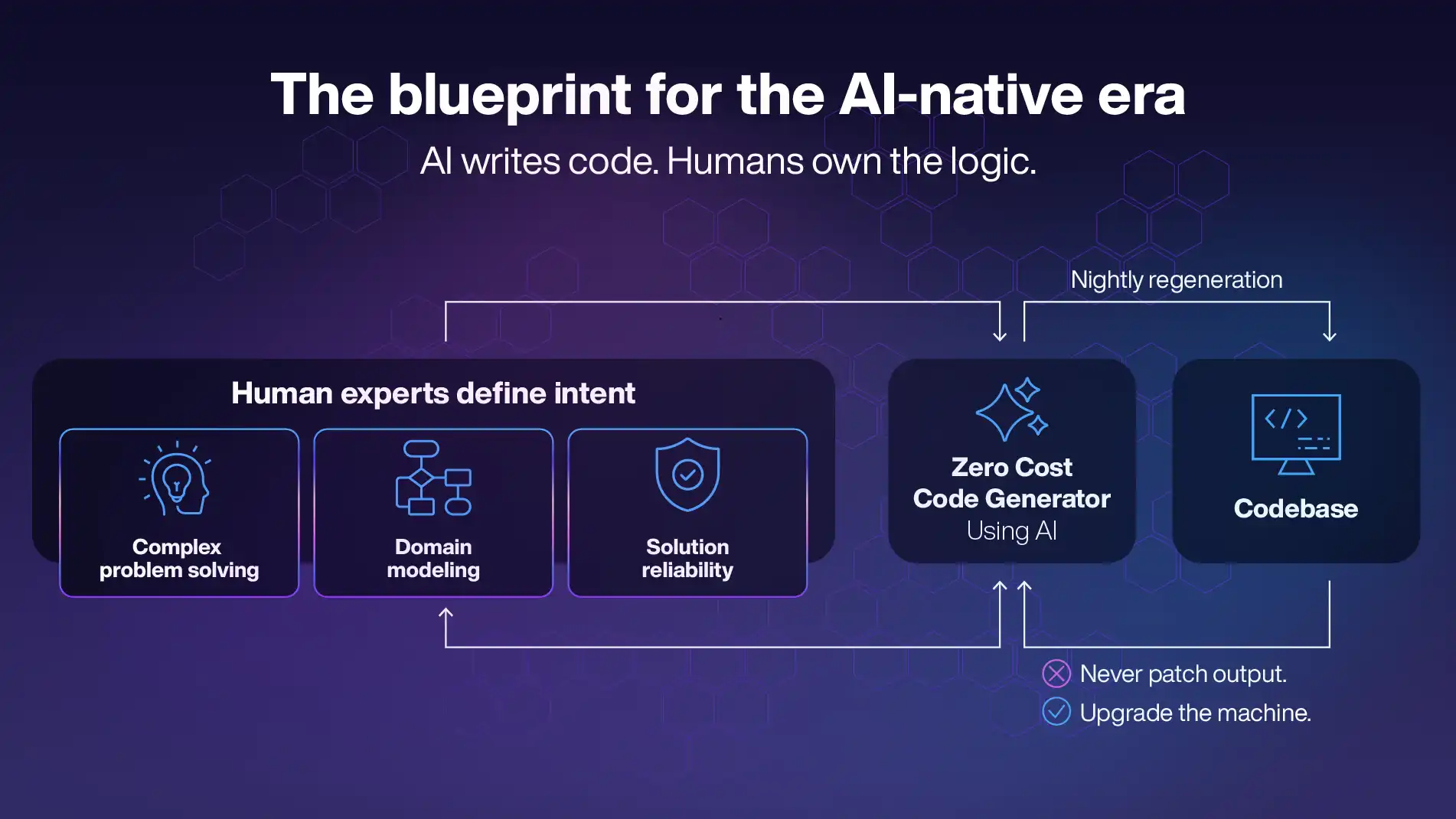

L’intention plutôt que la syntaxe : une décennie de code à coût marginal nul

Nous n’avons pas besoin de deviner ce qui arrive à un modèle économique lorsque la génération de code devient gratuite. Nous disposons d’un terrain d’expérimentation depuis une décennie.

Il s’appelle l’architecture basée sur l’intention. Ce n’est pas théorique ; nous utilisons ce modèle chez Manhattan Associates, où nous avons déplacé notre focus de l’écriture de la syntaxe vers la capture de l’intention métier il y a plus de dix ans. La philosophie est simple : les humains définissent le « quoi » (la logique métier et les règles), et les machines génèrent le « comment » (le code).

Par conséquent, nous ne maintenons pas une base de code legacy statique. À la place, nous régénérons chaque nuit environ 75 % de plus de 60 millions de lignes de code à partir de ces définitions d’intention.

Cette réalité opérationnelle apporte une leçon économique cruciale. Nous menons en pratique depuis une décennie une étude de cas sur l’ère du « coût marginal nul du code ». Comme la majorité de notre code est générée par machine, le coût d’écriture de cette syntaxe est déjà négligeable. Pourtant, cette efficacité n’a pas réduit nos coûts de développement à zéro. Elle nous a permis de réallouer ces ressources vers le « service » — la résolution de problèmes complexes, la modélisation métier et la fiabilité que les clients achètent réellement.

Cette régénération massive chaque nuit n’est pas un simple indicateur symbolique ; c’est la protection ultime contre la dette technique. Notre système ne vieillit pratiquement jamais, car il renaît toutes les 24 heures. Comme le code est généré par machine à partir de règles logiques strictes et non de probabilités, il est déterministe. Si le système calcule 2+2, le résultat sera toujours 4. Il n’y a aucune hallucination dans la logique métier. Tous les systèmes natifs de l’IA nécessitent une « colonne vertébrale déterministe » — un noyau rigide et fiable qui fait exactement ce qu’on lui demande.

Cette approche permet également un autre avantage majeur : la capacité d’injecter instantanément des capacités modernes sur une très large surface fonctionnelle. Par exemple, lorsque nous avons récemment voulu ajouter des audits en langage naturel — lisibles par des humains — à l’aide de LLM, nous avons simplement mis à jour le générateur de code central. En un cycle de build, la fonctionnalité s’est propagée à l’ensemble du portefeuille de solutions.

C’est le plan directeur de l’ère AI-native. Au lieu de demander à l’IA d’écrire du code jetable et risqué à la volée, l’approche durable consiste à laisser les humains définir l’intention métier et les machines gérer la génération du code. Si une exigence dépasse le périmètre actuel du générateur, il suffit de mettre à niveau le générateur. On ne corrige jamais la sortie ; on améliore la machine.

Composabilité : donner à l’IA un ensemble d’outils fiables

Une fois que vous disposez d’un noyau déterministe, vous devez offrir un moyen sûr pour que l’IA interagisse avec lui. C’est là qu’intervient la composabilité.

En découplant la logique de l’interface via une architecture API-first, la plateforme SaaS moderne devient un ensemble d’outils fiables que n’importe quel agent d’IA peut utiliser. Un agent d’IA n’a pas besoin de savoir comment effectuer un calcul logistique complexe. Il lui suffit de savoir quel endpoint API appeler pour obtenir le résultat.

L’IA agit comme orchestrateur, et l’API constitue la boîte à outils fiable.

Construire l’hybride parfait

Cette structure crée la combinaison idéale entre un flux probabiliste (IA) et un flux déterministe (système), optimisant à la fois la latence et les coûts. Nous n’utilisons pas une IA coûteuse et sujette aux hallucinations pour faire le travail « banal » de gestion des bases de données. Nous laissons un code généré et efficace s’en charger. Nous n’utilisons l’IA coûteuse pour le raisonnement que lorsque cela est nécessaire.

5. Conclusion : un cerveau probabiliste sur une colonne vertébrale déterministe.

Le SaaS n’est pas en train de mourir ; il est en train d'évoluer.

L’argument selon lequel « un code bon marché rend le logiciel sans valeur » ignore une réalité : les éditeurs de logiciels performants ont cessé de vendre du « code » depuis longtemps.

Le développement du « software » devient une commodité, et c’est une bonne chose. Cela réduit les coûts et accélère l’innovation. Mais le « service », là où résident l’expertise métier, l’architecture et la garantie de fiabilité, n’a jamais eu autant de valeur.

Nous ne savions pas il y a dix ans que nous construisions pour un futur agentique. Nous pensions simplement que la cohérence, la composabilité et l’efficacité étaient les seules façons de développer à grande échelle. Il s’avère que ces principes sont précisément les exigences d’un système natif de l’IA : un cerveau probabiliste combiné à une colonne vertébrale déterministe.

Alors que le marché s’inquiète de voir l’IA écrire du code, les gagnants seront ceux qui utiliseront l’IA pour renforcer le service qu’ils délivrent — prêts à s'intégrer à n’importe quelle interface que l’avenir fera émerger.